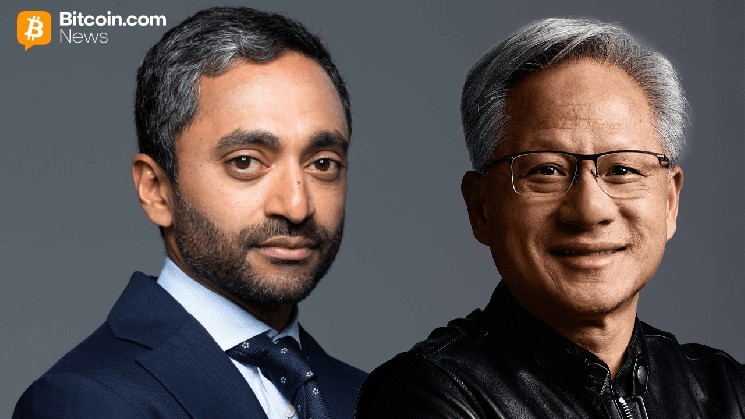

Une expérience d’IA décentralisée autrefois confinée aux cercles cryptographiques vient de recevoir l’approbation publique du PDG de Nvidia, Jensen Huang, signalant que la formation sur modèles distribués pourrait se rapprocher du grand public.

Chamath Palihapitiya a mis en lumière le Covenant-72B de Bittensor lors d’un épisode du podcast All-In, le présentant comme un exemple tangible d’intelligence artificielle (IA) décentralisée allant au-delà de la théorie. Bittenseur fonctionne comme un réseau décentralisé basé sur la blockchain qui établit un marché peer-to-peer dans lequel les modèles d’apprentissage automatique et le calcul de l’IA sont échangés et encouragés.

Palihapitiya a décrit l’effort en termes simples : un modèle linguistique à grande échelle (LLM) formé sans infrastructure centralisée, alimenté à la place par un réseau de contributeurs indépendants. « Ils ont réussi à former un modèle LLaMA de 4 milliards de paramètres, totalement distribué, avec un groupe de personnes contribuant en excès de calcul », a-t-il déclaré, qualifiant cela de « réalisation technique assez folle ».

La comparaison aboutit à une analogie familière. « Il y a des gens au hasard, et chaque personne reçoit une petite part », a ajouté Palihapitiya, faisant référence au premier projet d’informatique distribuée qui exploitait le matériel inutilisé dans le monde entier.

Huang n’a pas rejeté l’idée. Au lieu de cela, il s’est penché sur un cadre plus large du marché de l’IA, suggérant que les approches décentralisées et propriétaires ne s’excluent pas mutuellement. « Ces deux choses ne sont pas A ou B ; c’est A et B », a déclaré Huang. « Cela ne fait aucun doute. »

Cette double vision reflète une division – et un chevauchement – croissant au sein de l’IA. D’un côté se trouvent des systèmes fermés et très perfectionnés comme ChatGPT, Claude et Gemini. De l’autre, des modèles ouverts et décentralisés qui permettent aux développeurs et aux organisations de personnaliser les systèmes pour des besoins spécifiques.

Huang a clairement indiqué qu’il considérait les deux pistes comme essentielles. « Les modèles sont une technologie, pas un produit », a-t-il déclaré, notant que la plupart des utilisateurs continueront à s’appuyer sur des systèmes perfectionnés et à usage général plutôt que de créer les leurs à partir de zéro.

Dans le même temps, il a souligné les secteurs dans lesquels la personnalisation n’est pas facultative. « Il y a toutes ces industries dans lesquelles leur expertise dans un domaine… doit être capturée d’une manière qu’ils peuvent contrôler », a expliqué Huang, ajoutant que « cela ne peut provenir que de modèles ouverts ».

Cette déclaration atterrit carrément dans la timonerie de Bittensor. Covenant-72B, développé via son sous-réseau 3 (Templar), représente l’une des plus grandes formations décentralisées à ce jour, coordonnant plus de 70 contributeurs sur des connexions Internet standard sans autorité centrale.

Techniquement, le modèle repousse les limites. Construit avec 72 milliards de paramètres et formé sur environ 1 100 milliards de jetons, il exploite des innovations telles que les protocoles de communication compressés et le parallélisme des données distribuées pour rendre la formation viable en dehors des centres de données traditionnels.

Les mesures de performance suggèrent qu’il ne s’agit pas simplement d’une expérience. Les résultats de référence le placent en concurrence avec les modèles centralisés établis, un détail qui explique pourquoi le projet a attiré l’attention au-delà du public crypto-natif.

Le marché l’a également remarqué. Suite à cette annonce, le token TAO du projet a augmenté de 24 % depuis que la vidéo de Palihapitiya et Huang a fait le tour des réseaux sociaux.

Pourtant, les commentaires de Huang suggèrent que la véritable histoire n’est pas la perturbation, mais la coexistence entre les deux. Les systèmes d’IA propriétaires resteront probablement dominants pour les utilisateurs généraux, tandis que les modèles ouverts et décentralisés se réservent des rôles dans des applications spécialisées, sensibles aux coûts ou axées sur la souveraineté.

Pour les startups, le PDG de Nvidia a présenté un guide pragmatique : commencer de manière ouverte, puis intégrer des avantages propriétaires. « Chaque startup dans laquelle nous investissons actuellement est d’abord open source, puis passe au modèle propriétaire », a-t-il déclaré.

En d’autres termes, l’avenir de l’IA n’appartient peut-être pas à une seule architecture ou philosophie. Il peut appartenir à ceux qui savent naviguer dans les deux et savent quand les utiliser.

FAQ 🔎

-

Qu’est-ce que l’Alliance de Bittensor-72B ?

Un modèle linguistique de 72 milliards de paramètres formé via un réseau décentralisé de contributeurs sans infrastructure centralisée. -

Qu’a dit Jensen Huang à propos de l’IA décentralisée ?

Il a déclaré que les modèles d’IA ouverts et propriétaires coexisteraient, décrivant la relation comme « A et B », et non comme un choix entre eux. -

Pourquoi cette évolution est-elle importante ?

Il montre que les modèles d’IA à grande échelle peuvent être entraînés en dehors des centres de données traditionnels, remettant en question les hypothèses concernant les besoins en infrastructure. -

Comment cela affecte-t-il l’industrie de l’IA ?

Il soutient un avenir hybride dans lequel les plates-formes centralisées et les modèles décentralisés remplissent différents rôles selon les secteurs.